Azure ML Responsible AI Dashboard

เนื่องจากองค์กรต่าง ๆ ที่ใช้เทคโนโลยี AI ต้องมีความรับผิดชอบต่อผลกระทบทางสังคมของ AI จึงจำเป็นที่จะต้องให้ความสำคัญในการคาดการณ์ และลดผลกระทบต่าง ๆ ที่ไม่ได้ตั้งใจ องค์กรต่าง ๆ จึงต้องหานโยบาย แนวทางปฏิบัติ และเครื่องมือเพื่อเป็นแนวทางในการดำเนินการ

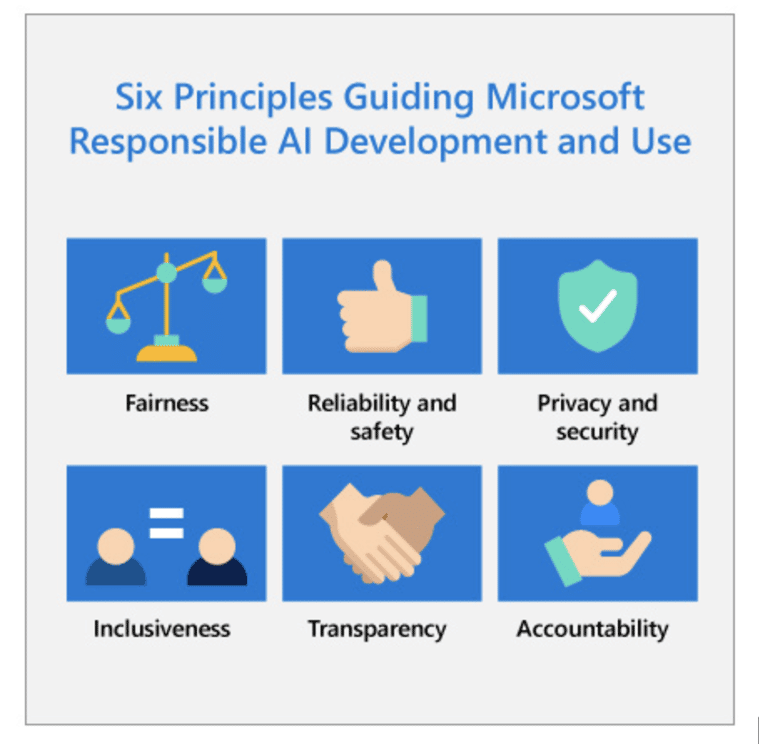

Microsoft ได้ตระหนักถึงปัญหาข้างต้น จึงได้เสนอหลักการสำหรับแนวทางในการพัฒนา และใช้งาน 6 หลักการ ซึ่งเป็นรากฐานที่สำคัญของแนวทางที่รับผิดชอบ และมีความน่าเชื่อถือได้โดยเฉพาะอย่างยิ่งเมื่อเทคโนโลยีอัจฉริยะกลายเป็นที่แพร่หลายมากขึ้น ปัจจุบัน Azure Machine Learning รองรับเครื่องมือสำหรับหลักการต่าง ๆ ทำให้นักพัฒนา Machine Learning และนักวิทยาศาสตร์ข้อมูล (Data Scientist) สามารถนำ Responsible ไปใช้ในทางปฏิบัติได้

- Fairness and inclusiveness

ระบบควรปฏิบัติต่อทุกคนอย่างยุติธรรม และหลีกเลี่ยงไม่ให้กระทบกระเทือนกลุ่มคนที่อยู่ใกล้เคียงกันในรูปแบบต่าง ๆ

Azure Machine Learning Responsible AI Dashboard ช่วยให้นักวิทยาศาสตร์ข้อมูล และนักพัฒนา ML สามารถประเมินความเป็นธรรมของแบบจำลองในกลุ่มที่มีความละเอียดอ่อนที่กำหนดไว้ในแง่ของเพศ ชาติพันธุ์ อายุ ฯลฯ

- Reliability and safety

ระบบจะต้องทำงานได้อย่างน่าเชื่อถือ ปลอดภัย และสม่ำเสมอภายใต้สถานการณ์ปกติ และในสภาวะที่ไม่คาดคิด สิ่งสำคัญคือ ต้องสามารถตรวจสอบว่าระบบเหล่านี้ทำงานตามที่ตั้งใจไว้ภายใต้สภาวะการทำงานจริงหรือไม่

- Transparency

เมื่อใช้ระบบเพื่อช่วยในการตัดสินใจที่ส่งผลกระทบอย่างมากต่อชีวิตของผู้คน ผู้คนจะต้องเข้าใจว่าการตัดสินใจเหล่านั้นเกิดขึ้นได้อย่างไร เช่น ธนาคารอาจใช้ระบบเพื่อตัดสินว่าบุคคลนั้นน่าเชื่อถือหรือไม่ หรือบริษัทอาจใช้ระบบเพื่อกำหนดผู้สมัครที่มีคุณสมบัติเหมาะสมที่สุดที่จะจ้าง

สำหรับ Azure Machine Learning มีความสามารถในการตีความแบบจำลองของ Azure Machine Learning และส่วนประกอบ What-If ที่ขัดแย้งกันของ Responsible AI dashboard ช่วยให้นักวิทยาศาสตร์ข้อมูล และนักพัฒนา ML สามารถสร้างคำอธิบายที่มนุษย์เข้าใจได้เกี่ยวกับการคาดคะเนของแบบจำลอง โดยให้มุมมองที่หลากหลายเกี่ยวกับพฤติกรรมของแบบจำลอง

- Privacy and Security

เนื่องจาก AI แพร่หลายมากขึ้น การปกป้องความเป็นส่วนตัว และการรักษาความปลอดภัยข้อมูลส่วนบุคคล และข้อมูลทางธุรกิจที่สำคัญจึงมีความสำคัญและซับซ้อนมากขึ้น ระบบ ต้องปฏิบัติตามกฎหมายความเป็นส่วนตัวที่กำหนดให้โปร่งใสเกี่ยวกับการเก็บรวบรวม การใช้ การจัดเก็บข้อมูล และคำสั่งที่ผู้บริโภคมีการควบคุมที่เหมาะสมในการเลือกวิธีการใช้ข้อมูลของตน

บน Azure Machine Learning การนำระบบส่วนตัวที่แตกต่างกันไปใช้เป็นเรื่องยาก SmartNoise เป็น open-source ที่พัฒนาร่วมกับ Microsoft ที่มีส่วนประกอบต่างกันสำหรับการสร้างระบบส่วนตัวที่แตกต่างกันทั่วโลก โครงการ SmartNoise ดูการรักษาความเป็นส่วนตัวของข้อมูลโดยใช้ความเป็นส่วนตัวที่แตกต่างกัน Azure Machine Learning ยังช่วยให้ผู้ดูแลระบบ DevOps และ MLOps สร้างการกำหนดค่าที่ปลอดภัย ด้วย Azure Machine Learning และแพลตฟอร์ม Azure เราสามารถ

- จำกัดการเข้าถึงทรัพยากรและการดำเนินการตามบัญชีผู้ใช้หรือกลุ่มของผู้ใช้

- จำกัดการสื่อสารเครือข่ายขาเข้า และขาออก

- เข้ารหัสข้อมูลระหว่างส่ง และเมื่อไม่ใช้งาน

- สแกนหาจุดบกพร่อง

- ตรวจสอบนโยบายการกำหนดค่า

- Accountability

คนที่ออกแบบ และปรับใช้ระบบจะต้องรับผิดชอบต่อการทำงานของระบบของตน องค์กรควรใช้มาตรฐานอุตสาหกรรมเพื่อพัฒนาบรรทัดฐานความรับผิดชอบ

ความรับผิดชอบใน Azure Machine Learning : MLOps ของ Azure Machine Learning จะอิงตามหลักการ และแนวทางปฏิบัติขิง DevOps โดยเฉพาะอย่างยิ่งสนับสนุนการประกันคุณภาพ และการติดตามแบบ end-to-end

Azure Machine Learning’s Responsible scorecard จะสร้างความรับผิดชอบโดยเปิดใช้งานการสื่อสารระหว่างผู้มีส่วนได้ส่วนเสีย และช่วยให้ผู้พัฒนา ML กำหนดค่า ดาวน์โหลด และแบ่งปันโมเดลกับผู้มีส่วนได้ส่วนเสีย เพื่อสร้างความไว้วางใจ

อ้างอิง https://docs.microsoft.com/en-us/azure/machine-learning/concept-responsible-ml

Contact Fusion Click